我有数据当前存储在我不想公开的 s3 存储桶中。我正在尝试 pandas.read_csv("s3_file_path") 在 docker 容器中运行的脚本中加载 pandas DataFrame。我收到权限被拒绝错误。如何在为 aws 提供所需权限的同时提取数据框?

该项目的最终目标是创建一个 RestApi,它将处理和使用一些数据的统计模型并返回结果。我也愿意采用完全不同的方法来完全避免这个问题。

由于我是这个 aws 帐户的唯一用户,为了让它正常工作,我尝试将我的 aws key 直接放在 Dockerfile 中并运行“aws configure”以基本上复制我在没有 docker 的情况下使用的确切过程。显然这是不安全的,但我只是想在开始实现更复杂的事情之前让它工作。不幸的是,它没有。

当前的 Dockerfile

FROM python:3

WORKDIR /usr/src/app

COPY requirements.txt ./

RUN pip install -r requirements.txt

ARG AWS_KEY=My_Actual_Public_Key_In_Plain_Text

ARG AWS_SECRET_KEY=My_Actual_Secret_Key_In_Plain_Text

ARG AWS_REGION='us-east-1'

RUN aws configure set aws_access_key_id $AWS_KEY \

&& aws configure set aws_secret_access_key $AWS_SECRET_KEY \

&& aws configure set default.region $AWS_REGION

COPY . .

CMD [ "python", "./run.py" ]

运行.py

from module import app

app.run(host="0.0.0.0", port = 80, debug = True)

来自 初始化 .py 在模块中

from flask import Flask

import pandas as pd

import numpy as np

file_name = "s3://foo/bar.csv"

df = pd.read_csv(file_name)

@app.route("/")

def index():

return("Hello World!")

我得到的错误是:

PermissionError:访问被拒绝

最佳答案

假设您有 s3fs根据 doc 安装.添加 print用于调试:

from flask import Flask

import pandas as pd

import numpy as np

file_name = "s3://foo/bar.csv"

df = pd.read_csv(file_name)

print(df)

app = Flask(__name__)

@app.route("/")

def index():

return("Hello World!")

引用。 Dockerfile reference :“ARG 指令定义了用户可以在构建时传递的变量” - 在这种情况下,您需要在运行时而不是在构建期间提供凭据,您可以在容器运行时环境中传递它们,例如:

FROM python:3

WORKDIR /usr/src/app

COPY requirements.txt ./

RUN pip install -r requirements.txt

ENV AWS_ACCESS_KEY_ID=${AWS_ACCESS_KEY_ID}

ENV AWS_SECRET_ACCESS_KEY=${AWS_SECRET_ACCESS_KEY}

ENV AWS_REGION='us-east-1'

COPY . .

ENTRYPOINT ["flask"]

CMD ["run"]

构建镜像:

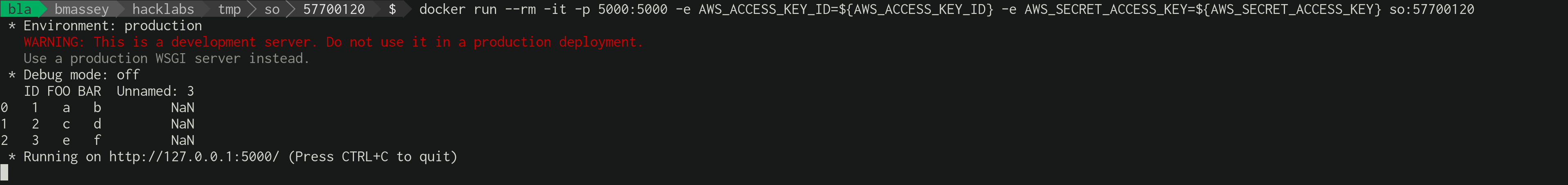

docker build --rm -t so:57700120 .运行容器:docker run --rm -it -p 5000:5000 -e AWS_ACCESS_KEY_ID=... -e AWS_SECRET_ACCESS_KEY=... so:57700120

备注 :

boto无法识别 AWS_KEY/AWS_SECRET_KEY引用。 doc有关已识别的环境变量的其他信息。

关于python - 如何从本地 Docker 容器中从 S3 中提取数据,我们在Stack Overflow上找到一个类似的问题: https://stackoverflow.com/questions/57700120/