最佳答案

让我们在两个与您发布的数据集相似的数据集上运行这两种算法,看看会发生什么......

编辑我之前发布的答案不正确。我忘记考虑高斯朴素贝叶斯的方差。 (之前的解决方案是使用具有固定恒等协方差的高斯函数的朴素贝叶斯,它给出了线性决策边界)。

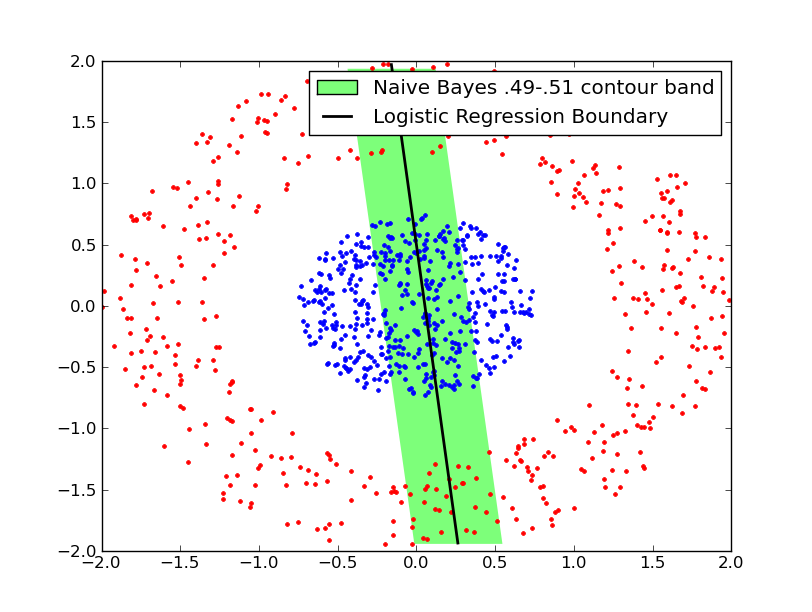

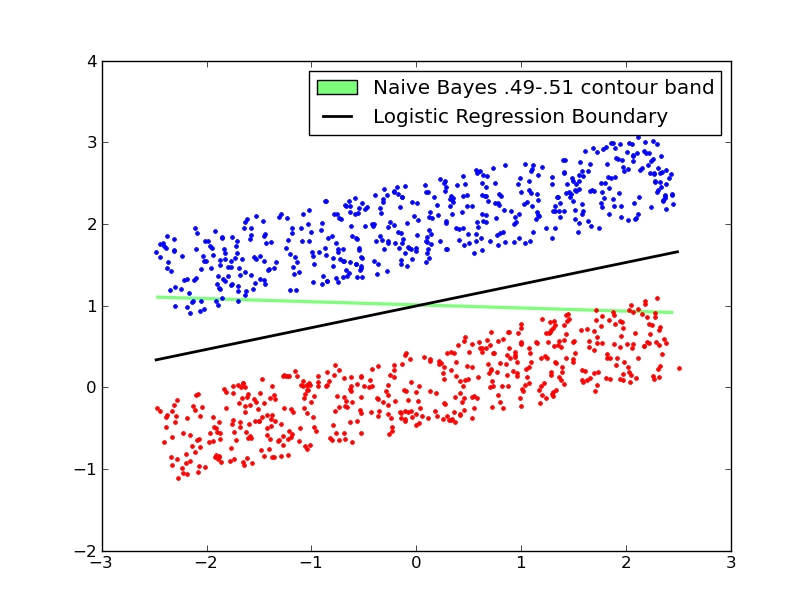

事实证明,LR 在循环数据集上失败了,而 NB 可以成功。 两种方法都在矩形数据集上取得了成功。

LR 决策边界是线性的,而 NB 边界是二次的(具有不同协方差的两个轴对齐高斯之间的边界)。

应用 NB 圆形数据集给出了大致相同位置的两个均值,但具有不同的方差,从而导致大致圆形的决策边界 - 随着半径的增加,与较低方差相比,较高方差高斯的概率会增加高斯。在这种情况下,内圆上的许多内点被错误分类。

下面的两张图显示了具有固定方差的高斯 NB 解。

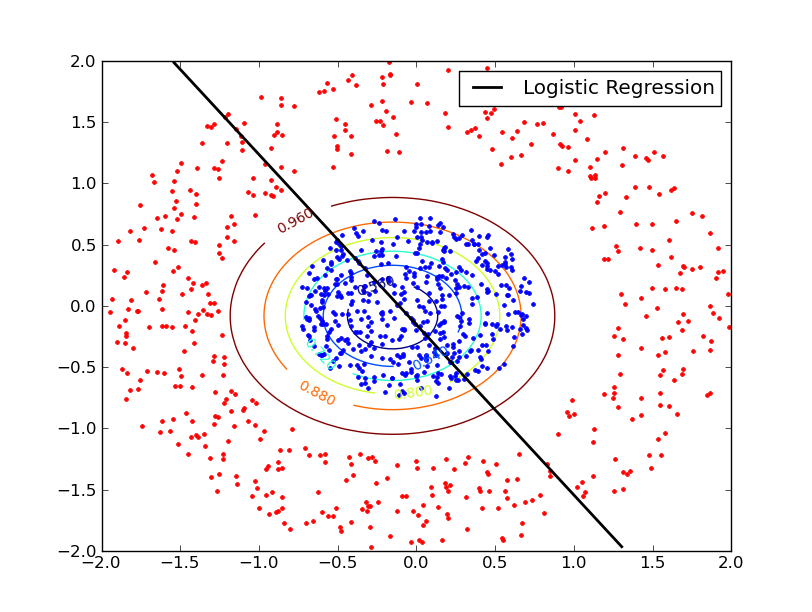

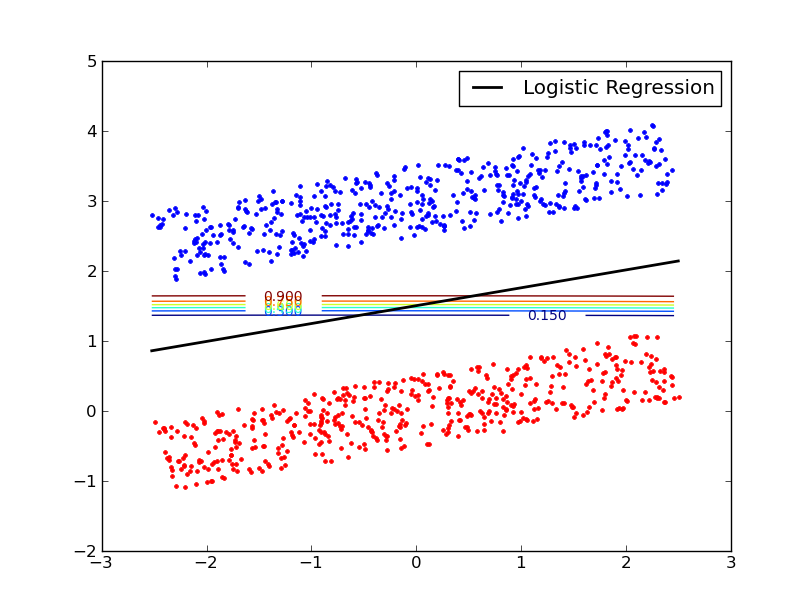

在下图中,等值线表示 NB 解的概率等值线。 该高斯 NB 解决方案还可以学习各个参数的方差,从而在解决方案中产生轴对齐的协方差。

关于machine-learning - 该数据集的逻辑回归和朴素贝叶斯,我们在Stack Overflow上找到一个类似的问题: https://stackoverflow.com/questions/21468469/