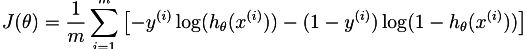

我刚开始在 Machine Learning 上 Andrew Ng 的类(class)在 Coursera 上。 第三周的主题是逻辑回归,所以我尝试实现以下成本函数。

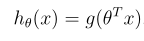

假设定义为:

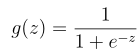

其中 g 是 sigmoid 函数:

这就是我的函数目前的样子:

function [J, grad] = costFunction(theta, X, y)

m = length(y); % number of training examples

S = 0;

J = 0;

for i=1:m

Yi = y(i);

Xi = X(i,:);

H = sigmoid(transpose(theta).*Xi);

S = S + ((-Yi)*log(H)-((1-Yi)*log(1-H)));

end

J = S/m;

end

给定以下值

X = [magic(3) ; magic(3)];

y = [1 0 1 0 1 0]';

[j g] = costFunction([0 1 0]', X, y)

j 返回 0.6931 2.6067 0.6931,即使结果应为 j = 2.6067。我假设 Xi 有问题,但我看不到错误。

如果有人能指出正确的方向,我将不胜感激。

最佳答案

您应该将 sigmoid 函数应用于参数向量 (theta) 和输入向量(Xi,在本例中为行向量)的点积。所以,你应该改变

H = sigmoid(transpose(theta).*Xi);

到

H = sigmoid(theta' * Xi'); % or sigmoid(Xi * theta)

当然,您需要确保将偏置输入 1 添加到您的输入中(一行 1 到 X)。

接下来,考虑如何将整个操作矢量化,以便可以在没有任何循环的情况下编写它。这样它会快得多。

关于matlab - 逻辑回归 - 计算成本函数返回错误结果,我们在Stack Overflow上找到一个类似的问题: https://stackoverflow.com/questions/31325834/